O ‘Project Warhol’ está oferecendo US $ 50/hora para capturar expressões faciais, fala e gestos dos participantes para treinar o modelo de avatares de codec da Meta.

“O Projeto Warhol AIMS melhora a realidade virtual do futuro.

Em uma sessão gravada, você executará várias tarefas, como imitar expressões faciais, frases de leitura, fazer gestos manuais, seguir alvos oculares e fazer exercícios de gama de movimento inteiro “.

Recrutamento Para o projeto, está sendo tratado pela Appen Company Appen da AI em nome da Meta, e a captura está ocorrendo no prédio de 4 andares de 100.000 pés quadrados da Meta, em Pittsburgh, Pensilvânia.

Pittsburgh é onde, há mais de uma década, a Meta está pesquisando e desenvolvendo a tecnologia que chama de avatares de codec, representações digitais fotorrealistas de seres humanos impulsionados em tempo real pelo rastreamento de fones de ouvido VR. O protótipo da mais alta qualidade alcança o feito notável de atravessar o vale estranho, em nossa experiência.

O objetivo dos avatares do codec é oferecer verdadeira presença social, o sentimento subconsciente de que você está realmente com outra pessoa, apesar de não estar fisicamente lá. Hoje, nenhuma tecnologia de remessa pode fazer isso. Chamadas de vídeo nem chegam perto.

Nesta entrevista, é provável que os avatares estejam sendo decodificados e renderizados por um PC de ponta.

Meta disse ao Business Insider, que primeiro identificado Projeto Warhol, que está executando estudos de coleta de dados do Avatar há anos. Mas o Meta parece estar cada vez mais perto de enviar avatares de codec em um fone de ouvido, e as referências a avatares de codec foram descobertas no Código de Quest’s Horizon OS Desde o início de 2024.

Em setembro de 2024 Meta, então vice -presidente de VR/Sr. Mark Rabkin disse a Engadget “Acho que provavelmente, se nos sairmos muito bem, deve ser possível no fone de ouvido da próxima geração”, em referência aos avatares do Codec.

Avatares de codec sendo decodificados no Quest 2 Standalone em 2021.

A meta ficou sólida progresso Ao decodificar avatares em hardware móvel independente. O maior desafio restante é restringir a lacuna de qualidade entre os avatares de codec gerados usando uma plataforma de captura especializada com mais de 100 câmeras e aquelas geradas por meio de um smartphone ou varredura de fone de ouvido, o processo prático para um sistema de remessa.

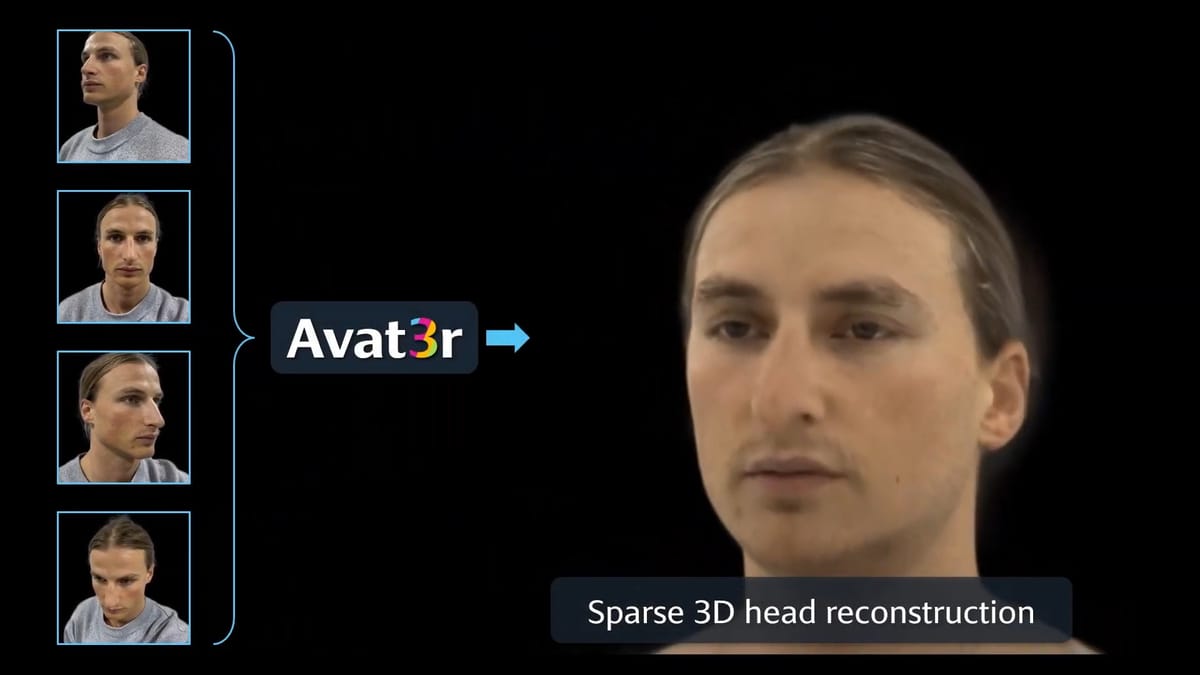

A empresa mostrou que os avatares de codec gerados a partir de uma varredura de smartphone em 2022mas esse sistema exigiu fazer 65 expressões faciais ao longo de mais de três minutos, e os dados capturados levaram várias horas para processar. No início deste ano, mostrou um novo sistema Isso precisa de apenas quatro selfies de telefone, e o processamento leva uma questão de minutos, não horas. Mas ele funciona a apenas 8 fps em um RTX 3090.

Meta pesquisa: avatares fotorrealistas de apenas 4 selfies

Os pesquisadores de meta construíram um “grande modelo de reconstrução (LRM)” que pode gerar uma cabeça de avatar fotorrealista animada em minutos a partir de apenas quatro selfies.

Meta Connect 2025 acontecerá de 17 de setembroe a empresa pode compartilhar progresso nos avatares do codec então. Uma possibilidade é também que ele lança uma versão rudimentar de tela plana primeiro, para permitir que você participe de chamadas de vídeo WhatsApp e Messenger com uma forma mais realista do que Seu meta avatar. Mas o envio de avatares de codec VR do tipo Meta prometeu exigirá a oferta de um fone de ouvido com rastreamento de rosto, e todos os sinais apontam para o próximo fone de ouvido que chega em 2026não este ano.

Listagem de grupos focais sugere a missão 4 pode ter rastreamento de rosto e olho

Isso chama os testadores de grupos focais para um novo meta dispositivo sugerindo que a Quest 4 terá rastreamento de rosto e olho?

Leave a Reply